IA en santé : Pourquoi l’évaluation n’est pas une option ?

L’intelligence artificielle s’impose progressivement dans le secteur de la santé. Ses applications se multiplient : aide au diagnostic, aide à la rédaction de comptes-rendus médicaux, analyse d’imagerie médicale, optimisation des parcours de soins… Mais la santé n’est pas un domaine d’application comme les autres. Les enjeux sont critiques : il est question de la sécurité et, in fine, de la vie des patients.

Dans ce contexte santé, comme dans tous les secteurs critiques, l’usage de l’IA exige des garanties élevées en matière de fiabilité. Chaque décision assistée par IA doit pouvoir être comprise, vérifiée et encadrée, afin d’assurer une prise en charge sûre et éthique.

Donc oui, cela peut paraître évident : évaluer les systèmes d’IA n’est plus une option. Mais ça va toujours mieux en le disant… et encore mieux en le faisant.

Responsabilité médicale + IA : sans évaluation, l’équation ne tient pas

Avec l’IA, la responsabilité médicale entre dans une zone de tension inédite.

Sur le papier, rien ne change : le médecin reste responsable de la décision finale. Les textes déontologiques et les prises de position de l’Académie nationale de médecine ou la Haute Autorité de Santé sont clairs : l’IA est un outil d’aide à la décision, pas le décideur. Mais dans la pratique, la situation se tend. Parce que suivre les recommandations générées par IA ne protège pas. Si l’IA se trompe, le médecin est responsable. Et ne pas la suivre peut aussi être reproché au praticien, surtout si l’outil est reconnu comme performant. Un piège à double entrée ? Le praticien devient alors arbitre d’un système qu’il peut ne pas maîtriser complètement… tout en restant juridiquement seul en première ligne. C’est précisément ce paradoxe qui change la donne : l’évaluation des systèmes d’IA n’est plus seulement un sujet technique — c’est une question de confiance. Sans cela, on demande aux médecins de prendre des décisions critiques… sur la base d’outils dont la fiabilité n’est pas toujours démontrée ni comprise.

Une réglementation européenne qui (se) structure…

En Europe, la réglementation des logiciels à finalité médicale, y compris les solutions intégrant de l’IA, repose sur le règlement sur les dispositifs médicaux (MDR (UE) 2017/745 et IVDR (UE) 2017/746). Ils imposaient déjà des exigences en matière d’évaluation mais avec l’adoption du règlement (UE) 2024/1689 sur l’IA (AI Act), le cadre s’est densifié. L’AI Act introduit une approche fondée sur le niveau de risque. Dans ce contexte, les systèmes d’IA intégrés dans des dispositifs médicaux régis par le MDR ou l’IVDR sont, dans la majorité des cas, classés comme systèmes à haut risque. Ils sont donc soumis à des obligations supplémentaires, notamment en matière de gouvernance des données, de transparence, de supervision humaine et de surveillance continue. Il en résulte un double cadre réglementaire : les acteurs devront désormais articuler les exigences propres aux DM avec celles spécifiques à l’IA.

Et puis il y a les normes harmonisées… Derrière ce terme se cache un élément clé de la réglementation : ce sont des standards (élaborés par le CEN/CENELEC) qui traduisent les exigences réglementaires en exigences techniques. En pratique, il faut comprendre que le règlement dit ce qu’il faut atteindre et les normes harmonisées expliquent comment y parvenir. Lorsqu’un fabricant applique ces normes, il bénéficie d’une présomption de conformité aux exigences réglementaires. Problème : pour l’AI Act, beaucoup des normes ne sont pas encore harmonisées. Mais pas de panique, des normes existent déjà et vous donne de premières clés.

Le calendrier de mise en œuvre de l’AI Act, pourtant récemment adopté, est déjà en train d’évoluer. Selon les dernières discussions au niveau européen, notamment dans le cadre du Digital Omnibus, le Parlement européen propose de reporter l’entrée en application des dispositions les plus structurantes du règlement. Concrètement, les obligations pour les systèmes d’IA à haut risque initialement prévues pour août 2026 pourraient être repoussées à décembre 2027. Pour les systèmes intégrés dans des produits régulés (dont les DM), l’échéance pourrait aller jusqu’à août 2028.

À court terme, ce décalage peut être perçu comme une bonne nouvelle avec moins de pression immédiate et plus de temps pour se préparer. Mais à moyen terme, il pose l’enjeu d’une absence de cadre stabilisé peut ralentir les décisions et entretenir une forme d’attentisme. Et surtout, il ne change rien sur le fond : les exigences restent ; la trajectoire réglementaire est confirmée et la pression sur la fiabilité des systèmes continue d’augmenter.

Une différence d’approche de la FDA

Les États-Unis, via la Food and Drug Administration (FDA), adoptent une approche sensiblement différente. Contrairement à l’AI Act, la FDA ne propose pas de classification transversale “IA à haut risque” et n’impose pas de cadre horizontal couvrant tous les secteurs. Elle privilégie une approche au cas par cas, centrée sur le produit et son usage. Résultat : plus de flexibilité pour les industriels mais aussi moins d’harmonisation pour les intégrateurs/utilisateurs.

Par ailleurs, la FDA a très tôt identifié une spécificité clé de l’IA : sa capacité à évoluer dans le temps. Elle a ainsi introduit le concept de “Predetermined Change Control Plan” (PCCP), qui doit permettre d’anticiper les évolutions des algorithmes après leur mise sur le marché. Concrètement, le fabricant décrit à l’avance les types de modifications prévues ainsi que les méthodes de contrôle associées et ces évolutions peuvent ensuite être déployées sans nouvelle revalidation complète, si elles respectent le cadre défini.

Comment agir dès maintenant ?

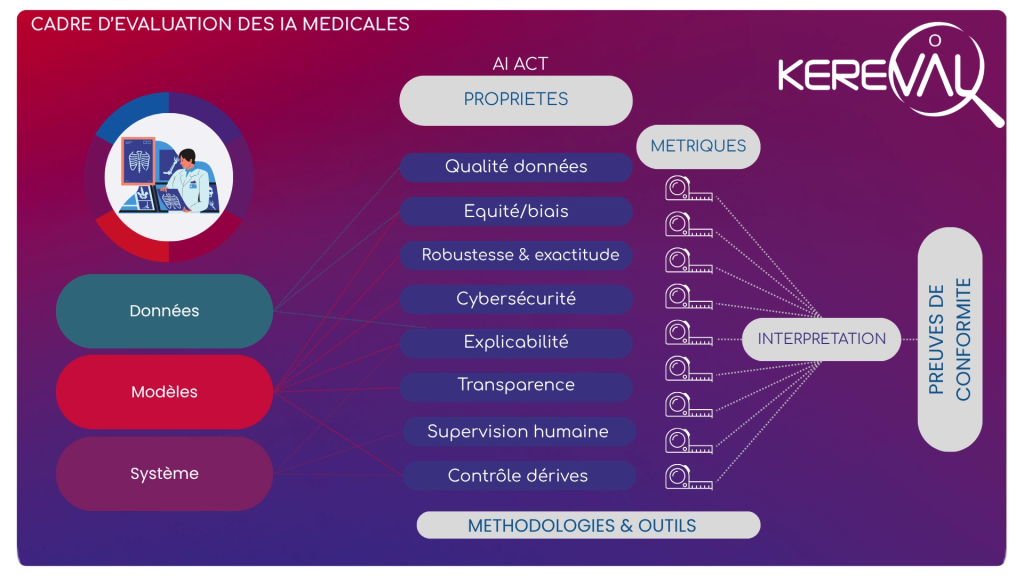

Le règlement européen impose d’évaluer un ensemble de propriétés de confiance, parmi lesquelles :

- Qualité des données (pertinence, représentativité, absence de biais) 👉 Article 10 – Data and data governance

- Robustesse et précision 👉 Article 15 – Accuracy, robustness and cybersecurity

- Gestion des risques 👉 Article 9 – Risk management system

- Transparence et explicabilité 👉 Article 13 – Transparency and provision of information to users

- Supervision humaine 👉 Article 14 – Human oversight

- Cybersécurité 👉 Article 15 – (également couvert avec robustesse et précision)

- Surveillance post-déploiement 👉 Article 72 – Post-market monitoring

Et surtout, ces exigences s’appliquent sur toute la durée de vie du système, pas uniquement au moment de sa mise sur le marché.

On pourrait penser qu’un cadre unifié existe déjà pour guider l’évaluation des systèmes d’IA en santé.

Spoiler : pas encore !

La communauté scientifique s’organise néanmoins activement, avec des initiatives comme TRIPOD-AI, PROBAST-AI, CONSORT-AI, FUTURE-AI ou TEF-Health, qui contribuent à structurer progressivement les pratiques. Faut-il s’inquiéter de l’absence d’une “checklist” universelle ? Probablement pas, surtout que sa faisabilité est discutable. La diversité des cas d’usage, des niveaux de risque et des technologies rend illusoire l’idée d’un cadre unique applicable à toutes les situations. Ce qui émerge aujourd’hui est plutôt une approche structurée mais adaptable : un socle de principes porté par l’AI Act, complété par des méthodologies spécifiques selon les contextes. L’enjeu n’est donc pas d’attendre une grille parfaite, mais de mobiliser intelligemment les méthodes, outils et expertises déjà disponibles.

À partir du cadre présenté, l’idée n’est pas de chercher une métrique unique, mais de multiplier les points de mesure.

D’abord, côté données, il s’agit de vérifier qu’elles sont cohérentes avec l’usage attendu. Sont-elles représentatives des patients réels ? Les datasets d’entraînement, de test et de validation sont construits de manière cohérente ? Y a-t-il des biais évidents ? La qualité est-elle homogène ? À ce stade, on ne “teste” pas encore l’IA, mais on s’assure que le socle de données est solide. Une vigilance particulière est également nécessaire sur l’usage de données synthétiques, qui peuvent introduire ou amplifier certains biais.

Ensuite, côté modèle, on regarde bien sûr sa performance, mais pas uniquement. La question devient : est-ce que le système reste fiable dans des situations limites ? Par exemple, lorsque les données diffèrent légèrement de celles utilisées à l’entraînement, le comportement reste-t-il cohérent ? L’objectif est de comprendre dans quelles conditions le modèle fonctionne… et surtout dans lesquelles il ne fonctionne plus.

Enfin, côté système, on se rapproche des conditions réelles d’usage. Comment l’IA s’intègre-t-elle dans le parcours de soin ? Est-elle compréhensible et utilisable par les professionnels ? Influence-t-elle la décision de manière appropriée ? C’est souvent à ce niveau que se révèlent les écarts entre une IA performante “en laboratoire” et une IA réellement utile en pratique. Cela pose directement la question de la supervision humaine, mais aussi de la capacité à suivre le système dans le temps : quelles mises à jour sont réalisées, comment les performances évoluent, et quelle chaîne de gestion (type MLOps) est en place pour garantir un fonctionnement maîtrisé.

Évaluer n’est pas (seulement) valider cliniquement

Quand on parle de DM intégrant de l’IA, il est important de distinguer évaluation technique et validation clinique, d’un point de vue réglementaire, car elles répondent à des exigences différentes.

Avec le MDR (UE) 2017/745, la validation clinique est une obligation centrale : elle vise à démontrer que le DM est sûr et performant dans un contexte clinique réel, et qu’il apporte un bénéfice pour les patients. Cela passe par des données cliniques, des études et une démonstration du rapport bénéfice/risque.

L’AI Act, lui, introduit des exigences complémentaires, davantage centrées sur le fonctionnement du système d’IA lui-même : qualité des données, robustesse, gestion des biais, transparence, supervision humaine ou encore surveillance post-déploiement.

Ces deux démarches sont donc complémentaires, mais non interchangeables dans le cadre d’un DM avec IA.

Et Kereval dans tout cela ?

L’IA en santé devient une réalité opérationnelle. Mais dans un domaine où chaque décision peut avoir des conséquences vitales, son intégration ne peut reposer sur la seule performance technique. Ce qui se joue aujourd’hui, c’est de passer d’une logique de validation ponctuelle à une culture de l’évaluation continue. L’AI Act, malgré ses ajustements calendaires, confirme cette trajectoire. Il ne s’agit plus seulement de prouver qu’un système fonctionne, mais de démontrer qu’il reste fiable dans le temps.

Dans ce contexte, l’évaluation devient un levier de confiance :

- confiance pour les professionnels de santé, qui doivent pouvoir s’appuyer sur ces outils pour prendre des décisions ;

- confiance pour les patients, dont la sécurité dépend directement de ces systèmes.

Attendre un cadre parfait ou une méthode universelle serait une erreur. Les outils, les référentiels et les bonnes pratiques existent déjà. L’enjeu est désormais de les mobiliser de manière structurée. Et c’est là qu’intervient Kereval et son équipe IA. Nous nous positionnons comme un acteur tiers de confiance dans l’évaluation des systèmes complexes intégrant de l’IA.

Concrètement, l’approche de Kereval consiste à :

- Structurer l’évaluation selon les exigences réglementaires (MDR, IVDR, AI Act) et les référentiels émergents ;

- Multiplier les angles d’analyse : données, modèles, système, usages réels ;

- Mettre en place des méthodologies adaptées à chaque cas d’usage ;

- Accompagner dans la durée, notamment sur les enjeux de surveillance post-déploiement (MLOps, gestion des mises à jour).

L’objectif n’est pas seulement de “valider” une IA, mais de sécuriser son usage, en apportant des éléments tangibles de confiance à toutes les parties prenantes.

Pour aller plus loin

- AI Act : https://eur-lex.europa.eu/eli/reg/2024/1689/oj/eng

- Stratégie Data et IA de l’Agence Nationale de Santé : https://sante.gouv.fr/IMG/pdf/strategie_donnees_et_intelligence_artificielle.pdf

- Guide HAS sur le choix des DM numériques : https://www.has-sante.fr/upload/docs/application/pdf/2023-06/dispositif_medicaux_numerique_a_usage_professionnel_guide_daide_au_choix.pdf

- Guide HAS/CNIL sur le bon usage des systèmes d’IA en contexte de soins : https://www.cnil.fr/sites/default/files/2026-03/guide_has_cnil_recommandations_ia.pdf

- Analyse sur l’IA et la responsabilité médicale de l’Académie nationale de médecine : academie-medecine.fr/…/intelligence-artificielle-et-responsabilite-medicale-quels-enjeux/

Plus d’informations sur nos activités de conseil et de test d’IA :

https://www.kereval.com/test-de-lintelligence-artificielle/

Vous souhaitez en savoir plus, contactez directement lea.deswarte@kereval.com